服务器是CPU还是GPU?2026年企业采购如何平衡算力需求?

概述:最近帮一个做医疗影像分析的老客户升级服务器,他们技术总监上来就问:"现在买服务器到底该堆CPU还是砸GPU?"这个问题在2026年3月的当下特别有代表性。随着AI推理任务 ** 式增长,国内服...

最近帮一个做医疗影像分析的老客户升级服务器,他们技术总监上来就问:"现在买服务器到底该堆CPU还是砸GPU?"这个问题在2026年3月的当下特别有代表性。随着AI推理任务 ** 式增长,国内服务器市场出现明显分化——金融、政务等传统领域依然偏爱多核CPU,而自动驾驶、生物计算这些新赛道已经全面转向GPU集群。今天我们就掰开揉碎聊聊这个事。

CPU和GPU在服务器里的真实分工

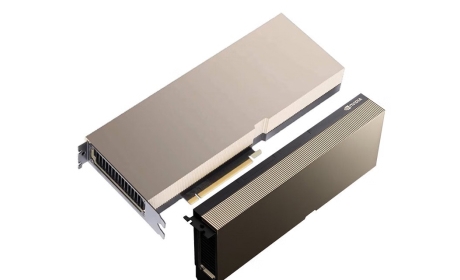

上周刚给杭州某三甲医院交付的基因测序服务器就很典型。2颗英特尔第六代至强8490H搭配4块英伟达H200,这种"CPU+GPU"的混合架构现在越来越普遍。CPU负责调度任务和串行计算,GPU专攻深度学习模型的矩阵运算。2026年Q1的采购数据显示,国内企业级服务器中纯CPU配置占比降到61%,而混合架构暴增到27%。

价格方面,目前主流服务器CPU(比如至强8462Y)单颗批发价在1.8万左右,而一张H200显卡要6.5万。但千万别只看单价,某短视频平台用32块H200替换原有CPU集群后,AI推荐算法耗时从23毫秒降到4毫秒,电费省了40%。这就是为什么2026年越来越多的企业开始算总账。

什么样的业务必须用GPU服务器?

前几天有个做智慧城市的老总跟我吐槽:"买了8块显卡结果天天吃灰。"这就是典型的需求错配。根据2026年最新行业实践,三类业务必须上GPU:

1. 实时视频分析类:像高速公路的违章识别系统,现在都是用A100 80GB做边缘推理,延迟要求控制在50毫秒内

2. 分子动力学模拟:某新冠特效药研发企业,用32块H800跑分子对接,把原本3个月的计算缩短到9天

3. 大语言模型微调:哪怕只是7B参数的小模型,用至强CPU训练要三周,换A800只要56小时

但如果只是跑数据库或者虚拟化,堆CPU核心数反而更划算。深圳某证券公司的行情系统,用96核的至强8490H处理千万级并发,比他们原来用显卡的方案省了200多万。

2026年混合架构的最佳实践方案

现在最火的配置是"2+4"组合——2颗CPU带4块GPU。这个配置在2026年3月的批发价大约38万,能兼顾传统业务和AI需求。具体怎么选配件有讲究:

CPU方面建议:

- 英特尔至强8462Y(48核/96线程)

- AMD霄龙9654(96核/192线程)

GPU搭配方案:

- 中等负载:4块RTX 6000 Ada(48GB显存)

- 重度AI:4块H200(141GB显存)

内存千万别省,现在DDR5-5600 64GB条子单根不到2000,建议至少插满16根。还有容易被忽视的硬盘IO问题,很多客户买完高端显卡结果被硬盘拖后腿。建议配两块企业级固态做缓存,比如希捷X2240,4TB版本读写能到6800MB/s。

为什么2026年要先想清楚业务场景?

上个月有个做档案数字化的客户,非要学别人买显卡服务器。后来发现他们主要做OCR识别,其实用至强CPU加FPGA加速卡就够了,省下的钱够买三台高速扫描仪。现在这行有个通病——看见别人用显卡就盲目跟风。

判断方法很简单:

1. 先看业务代码里有没有CUDA调用

2. 测试现有CPU负载,如果核心利用率长期低于60%就别急着换

3. 算算电费,GPU服务器虽然快但功耗可能是CPU的三倍

去年某省级政务云平台就吃过亏,采购时没考虑数据中心的电力容量,结果显卡服务器到了才发现配电不够,只能当普通服务器用。

采购前必须弄明白的五个细节

第一是散热问题。现在单块H200显卡TDP就有700W,传统1U机箱根本压不住。建议至少用2U机箱,最好上液冷。北京某AI公司去年就因为散热不足,导致显卡长期降频运行,实际性能只有标称的65%。

第二是软件生态。有的行业软件压根不支持GPU加速,比如某些老牌ERP系统。前两天还有客户抱怨,花大价钱买的显卡只能用来跑屏幕保护程序。

第三是运维成本。显卡驱动更新比CPU频繁得多,某直播平台运维总监跟我说,他们专门雇了两个工程师全职维护显卡集群。

第四是二手残值。2026年市场上流通的二手服务器显卡,贬值速度比CPU快30%。如果项目周期短,可以考虑租赁方案。

第五是供货周期。目前H200的交付周期要45天左右,而CPU基本都有现货。着急上线的项目要做好预案。

其实不管是CPU还是GPU,关键是要匹配业务需求。我们经手的客户里,凡是采购前做好业务评估的,后期使用满意度都高出很多。现在行业里有个新趋势——先租三个月试运行,效果好再买断。这个法子能避免很多决策失误。