GPU服务器怎么选?2026年企业级配置与采购避坑指南

概述:最近帮客户配了几台AI训练服务器,发现2026年的GPU市场比想象中还热闹。英伟达刚发布的B100显卡供货紧张,国产算力卡价格战打得凶,连企业级硬盘都开始玩起了QLC颗粒。上周给某三甲医院部署...

最近帮客户配了几台AI训练服务器,发现2026年的GPU市场比想象中还热闹。英伟达刚发布的B100显卡供货紧张,国产算力卡价格战打得凶,连企业级硬盘都开始玩起了QLC颗粒。上周给某三甲医院部署医疗影像分析系统时,光是挑服务器配置就折腾了三轮方案。今天就结合最近的实际项目经验,聊聊怎么在2026年3月这个节骨眼上配出高性价比的GPU服务器。

2026年GPU服务器三大核心配置怎么搭

现在配服务器就像组装乐高,但关键部件得先锁定。目前主流方案分三种:

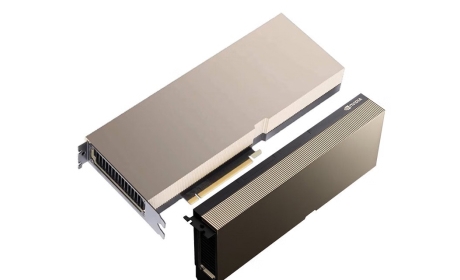

1. 双路B100配置:单卡768GB HBM3显存确实猛,但整套下来光显卡就要18万,适合预算充足的AI实验室。有个做自动驾驶的客户实测,8卡服务器训练效率比上代提升40%,就是配套的1600W电源模块经常缺货。

2. 国产算力卡方案:某国产6nm工艺的GPGPU卡现在3万出头就能拿下,性能约等于A800的80%。有个做直播鉴黄的客户用了16卡集群,每天处理200万小时视频流,电费比用进口卡省了三分之一。

3. 二手A100混搭:现在矿卡翻新的40GB版本A100均价2.3万,配上EPYC 9754处理器,跑Stable Diffusion这类应用依然能打。不过要当心某些批次的显存寿命问题,上周刚帮个客户退掉两台故障机。

建议先明确应用场景——如果是医疗影像重建这类高精度计算,建议咬牙上B100;要是做内容审核这种对精度要求不高的,国产卡可能更划算。

企业采购最容易踩的五个坑

上个月帮某省级政务云平台验收时,发现他们首批采购的服务器就有三个配置失误:

内存带宽没算清:给B100配的DDR5-5600内存实际带宽根本喂不饱显卡,后来全部升级到6400MHz才解决问题。现在16通道的EPYC平台建议至少配512GB内存,价格比去年降了15%,单条64GB的均价在1800元左右。

硬盘阵列拖后腿:见过最离谱的是用SATA SSD组RAID给GPU集群供数据,直接导致模型加载时间翻倍。现在企业级PCIe 5.0的固态才是王道,读取能到14GB/s,8TB版本批发价已经跌破6000。

散热方案没预留余量:有家互联网公司为了省机房空间选了2U机箱,结果夏天GPU动不动就降频。现在4U机箱带液冷模块的才是稳妥选择,虽然贵30%但能多用两年。

电源冗余不够:双路CPU+8块显卡的机器,建议配置2000W×2的冗余电源。去年有家券商因为电源故障导致量化交易中断,损失比服务器贵十倍。

运维端口被忽视:很多企业现在才开始重视BMC管理功能,其实远程控制、故障预警这些功能关键时刻能救命。

2026年存储方案新玩法

现在GPU服务器搭配存储有两个新趋势:

分层存储架构:热数据用PCIe 5.0固态,温数据放24盘位的U.2硬盘笼,冷数据交给60TB的HAMR机械盘。最近给某视频网站做的方案里,三种存储成本占比是5:3:2,比全闪存方案省了40%预算。

持久内存当缓存:Intel的傲腾虽然停产了,但新出的CXL 2.0内存扩展技术更狠。给某期货公司做的交易系统里,用512GB的CXL内存当缓存,把数据库查询延迟压到了3微秒以内。

最近不少客户在问QLC硬盘能不能用在生产环境,实测下来如果是读多写少的场景(比如视频点播),16TB的QLC企业盘写入寿命也能撑五年,关键是价格只有TLC的六折。

说到具体采购,建议重点关注这些参数:企业级硬盘的年度写入量至少要达到1.5倍预期值,显卡优先选带vGPU授权的版本,内存务必确认支持ECC校验。上周刚帮一个客户紧急调换了批标签写着"服务器专用"实则消费级颗粒的内存条,这种坑踩一次就够闹心的。

要是拿不准配置,可以把应用场景和预算区间发过来,我们技术团队会根据最新行情给你做三套比选方案。现在下单的话,还能赶上季度促销的配件升级活动,比如买满10块显卡送2块800GB的缓存盘,这个月已经帮七家客户搭了顺风车。