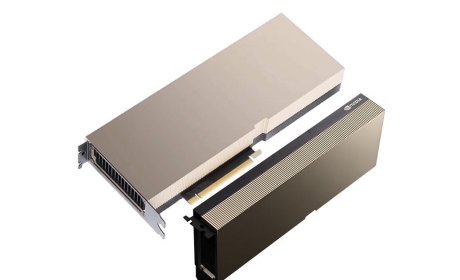

H100 GPU:NVIDIA 深度计算卡的算力巅峰解析

概述:NVIDIA H100 GPU 作为 Hopper 架构的首秀,被誉为史上最强大的 AI 与 HPC 加速器。这款革新性的计算卡以其非凡的运算能力、先进的内存技术和颠覆性的 Transformer...

Hopper 架构:突破性的硬件革新

H100 GPU 的核心在于突破性的 Hopper 架构设计。其采用了台积电 4N 先进制程工艺,集成惊人的 800 亿个晶体管。相比上一代 Ampere 架构的 A100 GPU,H100 在相同功耗下实现了显著的性能跃升。革命性的 Transformer 引擎专为当下主流的深度学习模型优化,结合第四代 NVIDIA NVLink 技术(带宽高达 900 GB/s)和 HBM3 高带宽内存,有效解决了超大模型训练中数据通路的瓶颈问题,让巨量参数模型的并行训练效率实现质的飞跃。

性能怪兽:量化指标的全面领先

在关键性能指标上,H100 GPU 展现出碾压级的优势:

这些数据意味着 H100 GPU 在处理复杂的科学计算、AI 推理和大规模数据分析任务时,能带来远超以往的计算吞吐量。特别是其强大的稀疏矩阵加速能力,能为推荐系统、生物信息学分析等场景带来极致的效率提升。

场景驱动:加速多元化应用落地

H100 GPU 的目标应用场景覆盖极广。它正在成为大型云数据中心、企业级 AI 平台和国家超算中心的标配加速器。在生成式 AI 领域(如大型语言模型 LLM、扩散模型),H100 显著缩短了模型的训练周期。在数字孪生与工业模拟方面,其强大的物理仿真能力加速了产品设计和验证流程。在医疗健康的基因组测序分析、金融科技的实时风险建模、自动驾驶的高精度仿真等前沿领域,H100 都提供了基石级别的算力支撑。其内置的 DPX 指令集也极大加速了动态规划算法,优化了物流路径规划、医疗影像分析等应用的执行效率。

生态赋能:塑造新一代计算基础设施

NVIDIA 的 H100 不仅仅是一个 GPU,更是其全栈计算平台的核心引擎。它与 CUDA

12、优化的深度学习框架(如 TensorFlow, PyTorch)、NGC 容器目录以及强大的 Omniverse 平台紧密协同。通过搭载 H100 的 DGX H100 超级计算机系统和 NVIDIA AI Enterprise 软件套件,企业能够快速部署和管理大规模 AI 工作负载。在数据中心层面,H100 GPU 对 PCIe Gen5 和最新 NVIDIA ConnectX-7 智能网卡的支持,配合其领先的能效比(单位算力能耗显著降低),助力构建更绿色高效的高性能计算集群。