自己搭GPU服务器怎么选配置?2026年显卡与存储方案推荐

概述:最近遇到好几个客户问同一个问题:2026年想自己搭GPU服务器,到底该怎么选配置?这问题确实挺值得聊的,尤其现在大模型训练、AI推理的需求越来越火,很多中小企业都开始自建计算集群。今天就从实际...

最近遇到好几个客户问同一个问题:2026年想自己搭GPU服务器,到底该怎么选配置?这问题确实挺值得聊的,尤其现在大模型训练、AI推理的需求越来越火,很多中小企业都开始自建计算集群。今天就从实际经验出发,说说该怎么搭配才算合理。

2026年GPU服务器配置怎么选最划算?

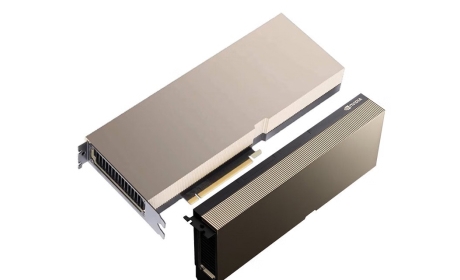

现在装GPU服务器和几年前完全不是一回事了。显卡价格这两年波动特别大,就拿RTX 4090来说,2026年3月国内批发价已经降到8500-9200元区间,比去年双十一还便宜了15%。但专业卡这边情况不一样,像A100 80GB现在还得卖到6万8左右,价格依然坚挺。

具体怎么选得看用途:

如果是做AI训练,建议直接上专业卡。虽然贵,但显存大、计算精度高,像A100的80GB显存跑大模型就是比消费级卡稳。但如果是做推理或者轻度学习,现在RTX 4090其实更划算,24GB显存应付大多数场景足够了。

内存方面有个新变化要特别注意,DDR5-6400 32GB单条的价格跌破700元了,比去年便宜一半。建议至少配256GB起步,现在深度学习框架吃内存特别厉害。

存储这块反而是最简单的,企业级U.2固态价格打下来了,3.84TB的盘现在2800左右就能拿到。建议系统盘用这个,再配几块16TB的机械盘做数据仓库,这样速度和容量都能兼顾。

组装GPU服务器要注意哪些坑?

前两天刚帮一个客户处理过散热问题。他买了8张RTX 4090塞进4U机箱,结果跑起来直接过热降频。现在高端显卡的散热确实是个大问题,建议:

1. 机箱至少选4U高度,最好带涡轮风扇的型号

2. 显卡间距要留够,双槽卡至少要隔一个PCIe位

3. 机房空调功率按每千瓦制冷量计算,现在显卡动辄450W一张

电源也要特别注意,2026年新出的ATX3.1标准电源更稳当。建议买额定功率是实际需求1.5倍以上的型号,比如8张RTX 4090至少要配2000W电源。

国产GPU现在值得考虑吗?

最近很多客户在问国产显卡行不行。实话说,2026年国产卡进步确实很大,比如某国产7nm芯片的FP32性能已经能摸到RTX 3080的水平了。但有两个问题还是要注意:

一是软件生态,像CUDA移植到现在还是有些框架不支持

二是供货稳定性,很多型号要提前三个月预定

如果是不太依赖特定框架的业务,比如一些图像处理场景,现在用国产卡确实能省30%左右的成本。但要做严肃的AI训练,建议还是再观望半年。

说到存储方案,现在有个新趋势是计算存储分离。就是把热数据放NVMe固态,冷数据放机械盘,中间用高速网络连着。这样升级硬件的时候不用全换,特别适合经常要扩容的场景。

企业级硬盘现在价格也下来了,16TB的监控盘1300左右就能拿货,比去年便宜了两成。建议选支持7×24小时运行的型号,虽然贵点但故障率能低不少。有些客户为了省钱买桌面级硬盘放服务器,结果三个月就坏,数据恢复的钱都比硬盘贵。

最后说个实在话,现在自己搭服务器确实比买整机省,但一定要找靠谱的渠道拿货。有些二手矿卡翻新后当新卡卖,用两个月就花屏。建议要买就找有三年保的渠道,贵是贵点,但省心。