4U GPU服务器怎么选?2026年高性能配置与采购避坑指南

概述:最近不少客户在后台问我:"2026年买4U GPU服务器到底该看哪些参数?"这问题问得挺及时。上个月刚帮深圳一家AI公司配了二十多台机器,正好把最新行情捋了一遍。现在市面上从三万到三十万的机型...

最近不少客户在后台问我:"2026年买4U GPU服务器到底该看哪些参数?"这问题问得挺及时。上个月刚帮深圳一家AI公司配了二十多台机器,正好把最新行情捋了一遍。现在市面上从三万到三十万的机型都有,关键得看准应用场景。

2026年4U机箱的黄金搭配方案

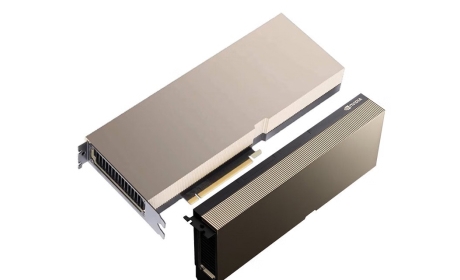

先说说今年的主流配置。标准4U机箱现在基本能塞下4张全高全长显卡,像英伟达H100这种大块头也能轻松驾驭。内存方面,DDR5-6400已经是起步配置,单条64GB成了企业级标配。有个有意思的现象:去年还火热的双路CPU方案,今年很多客 ** 成了单路EPYC 9654配满 PCIe 通道,毕竟现在GPU才是吃带宽的大户。

硬盘位设计今年变化最大。前排8个2.5寸热插拔盘位成了主流配置,支持U.2和 SATA 混插。有个做医疗影像的客户跟我说,他们现在每个节点配两块1.6TB的傲腾当缓存,后面接6块希捷银河X22企业盘,读CT片子速度比去年快了三倍。

散热方案到底选风冷还是液冷?

这个问题最近吵得挺凶。风冷派说维护方便,液冷派强调散热效率。实际测试下来,4U机箱里装三块H100的话,风冷确实有点吃力。上个月杭州某机房就出现过热降频,后来换了分体式水冷才稳住。但普通业务比如视频转码,用带均热板的涡轮卡其实完全够用。

现在成熟的方案是混合散热:CPU走水冷,GPU保持风冷。有个做量化交易的客户更绝,他们在机柜后面装了半导体空调,直接把机房温度压在18度。虽然电费高点,但保证全年无降频。

采购最容易踩的三个坑

第一个坑是电源配置。今年已经见过五起案例,客户为了省钱选低配电源,结果GPU根本跑不满。现在850W电源带单卡都勉强,推荐直接上2000W白金电源,留足余量。

第二个坑是PCIe拆分。有些便宜主板宣称支持x16拆分,实际只能拆成x8x8。今年Q1就有家游戏公司中招,买回来发现四块显卡互相抢带宽。现在靠谱的方案要么用PLX芯片,要么直接上支持x16x16x16x16拆分的服务器主板。

第三个坑更隐蔽:机箱风道设计。有些厂商为了省成本,前面板开孔率连40%都不到。实测这种机器满载时GPU温差能到15度以上。现在讲究的厂家都在用蜂窝式开孔,配合L型风道,差价也就两三百块,但稳定性天差地别。

今年这些新技术值得关注

NVLink4.0已经实装了,单卡间带宽翻到900GB/s。做LLM训练的客户反馈,比起上代产品,175B参数模型的训练时间缩短了37%。不过要注意,不是所有应用都能吃满这个带宽,像普通的图像识别就感受不到差别。

还有个惊喜是CXL内存扩展。现在单机可以挂4TB的持久内存,某省政务云用它来跑实时数据分析,响应速度直接进入毫秒级。虽然单条128GB的DDR5价格降到1800左右,但遇到海量数据处理时,CXL还是更划算。

该选整机还是自己组装?

这个问题没有标准答案。今年整机价格确实降了,像某品牌的双路4U机型,配四块H100报价28万,比自己组贵不到10%。但他们提供的三年上门服务确实省心,特别适合没有专业运维团队的客户。

自己组的话灵活性高很多。上周刚帮上海一家高校实验室配了台机器,用超微主板搭AMD线程撕裂者,省下的预算加了两块显卡。不过要注意,现在企业级配件缺货严重,像HBA卡这类小零件最好提前三个月订货。

最后说个真实案例。北京某AI公司去年图便宜买了二手服务器,结果今年升级时发现主板根本不支持新显卡。现在全套设备要淘汰,反而多花了一百多万。在快速迭代的GPU领域,适当超前配置才是真省钱。

看完这些,你应该对怎么选4U GPU服务器有数了。关键是根据实际负载选配置,别盲目追高配,但也别在关键部件上省钱。有具体需求的话,随时可以发配置单来帮你看合不合理。